Codziennie na całym świecie atakuje się tysiące stron internetowych i są kradzione setki terabajtów danych.

Firmy coraz częściej zmagają się z próbami włamania się na stronę przez boty (roboty). Zajmuje to dużo czasu i wymaga wielkich kosztów.

W kontekście bezpieczeństwa sieci istnieją dwa pojęcia: boty dobre i złe.

Dobre boty dodają informacje o witrynie do bazy danych wyszukiwarki. W ten sposób utrzymują widoczność strony w wyszukiwarkach, co z kolei prowadzi do wzrostu liczby użytkowników/klientów.

Złe boty dzielą się na kilka typów:

Spamboty

Spamboty – Xrumer i inne aplikacje wyszukują adresy e-mail na stronach internetowych, portalach społecznościowych. sieci, witrynach przedsiębiorstw i firm w celu wysyłania spamu.

Po zgromadzeniu listy adresów atakujący wysyłają wiadomości e-mail z linkami stron trzecich, złośliwymi kodami i wirusami.

Boty wyszukujące luki w zabezpieczeniach

Każdy CMS ma swoje luki, jak i obszary chronione. Boty wyszukujące luki w zabezpieczeniach, zwane również hakerami, wyszukują witryny z lukami w zabezpieczeniach i wysyłają raport na ich temat do programisty, który następnie sprzedaje te informacje lub wykorzystuje je do hakowania. Walka z botami, które próbują znaleźć luki w systemie, jest możliwa tylko przy ciągłych aktualizacjach.

Ckickboty

Clickboty — te boty oszukują za pomocą kliknięć, uszkadzając statystyki, zwiększając współczynniki odrzuceń i zawyżając czynniki behawioralne. Roboty klikają płatne reklamy, zwiększając koszt kliknięcia. Działania takich botów są bardzo kosztowne dla reklamodawców, chyba że do wykrywania i blokowania botów jest używane specjalistyczne oprogramowanie.

Boty-parsery i grabbery

Te boty zbierają treści ze stron internetowych. Badają bazy danych, zdobywają informacje i kopiują je do innej witryny.

Ataki polegające na wypełnianiu danych

Te boty kradną dane użytkowników, automatycznie sprawdzając wszystkie możliwe kombinacje kont i haseł lub wykorzystując znane i niezałatane luki w zabezpieczeniach.

Podczas próby włamania roboty te wykorzystują informacje skradzione z jednej witryny (dane użytkownika i hasła), aby spróbować połączyć się z innymi witrynami. Tego typu informacje identyfikujące są zwykle uzyskiwane w wyniku masowej kradzieży danych, a następnie są publikowane w domenie publicznej lub odsprzedawane.

Boty ze złośliwymi plikami

Te roboty uwzględniają zapytanie użytkownika i zgłaszają, że odpowiedź na zapytanie znajduje się w pliku, który najpierw trzeba pobrać, po czym podają link. Niczego niepodejrzewający użytkownik klika łącze, pobiera plik i otwiera go, nie zdając sobie sprawy, że zainfekował swój komputer.

Boty dobierające hasła

Takie roboty próbują znaleźć nazwę użytkownika i hasło do Twojej witryny, aby uzyskać dostęp administratora. Bot generuje hasła i raportuje, czy znaleziono prawidłowe.

Aby chronić swoją witrynę przed tego typu botami, możesz użyć specjalnego oprogramowania.

W tym celu powstał AntyBot.com.pl, który chroni witrynę w PHP przed wszystkimi typami botów wymienionych powyżej.

Funkcje AntyBot.com.pl to:

— ochrona przed parserami, grabberami, zapobiega kradzieży treści;

— walka z clickbotami;

— zapobieganie kradzieży haseł i eliminacja prób ich dobierania;

— eliminacja spamu poprzez formularze zwrotne;

— zapobieganie w gromadzeniu adresów e-mail do wysyłek spamowych;

— zmniejszenie ryzyka niedostępności strony z powodu dużego obciążenia serwera przez boty.

Skrypt jest wymagany w przypadku witryn rządowych, komercyjnych i innych.

AntyBot.com.pl nie blokuje dobrych botów i prawdziwych ludzi, i zapewnia bezpieczeństwo i ochronę witryny.

Jednym z przykładów instalacji AntyBot.com.pl jest strona internetowa artis-media.com.pl

Serwer został obciążony z powodu ataku bota. Liczba wiadomości spamowych z serwisu przekroczyła 50 e-maili dziennie. Próby włamania się na stronę przez boty średnio około 250 razy dziennie. Z powodu ataków na witrynę znalazła się na 20 pozycji w wynikach wyszukiwania Google.

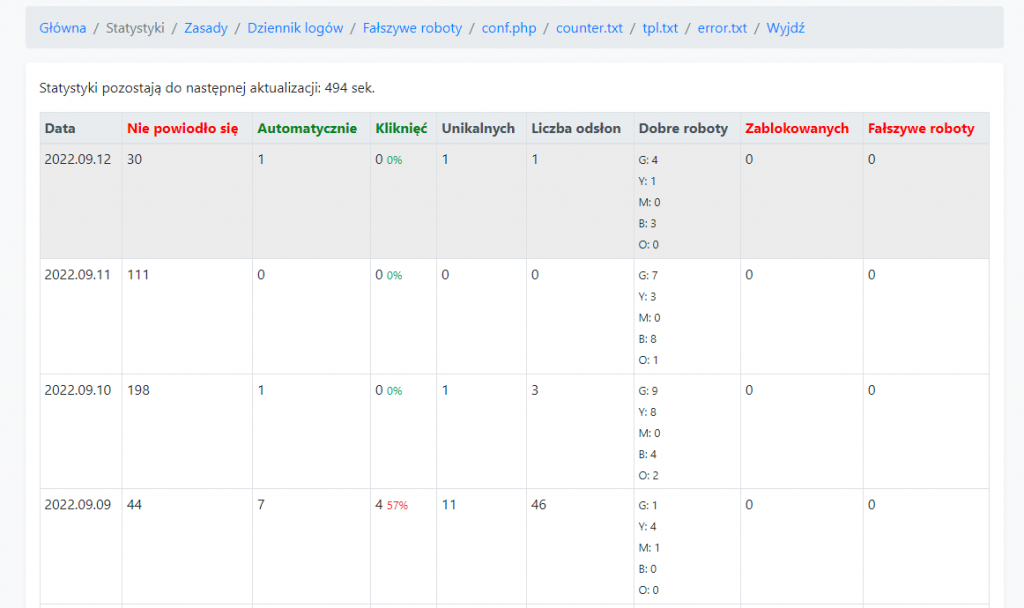

Po instalacji możesz obserwować następujące statystyki:

- Obciążenie serwera zmniejszyło się 3 razy. Wskaźnik mieści się w dopuszczalnym obciążeniu.

- Liczba wiadomości SPAM wynosi 0.

- Skrypt skutecznie zatrzymuje boty. Zmniejszono liczbę prób włamania z 256 do 0.

- Witryna awansowała do TOP 5 w wynikach wyszukiwania Google, podczas gdy wcześniej znajdowała się w TOP 20 wyników wyszukiwania.

Wykrywanie i blokowanie wejścia botów na stronę to odpowiedzialna i niezbędna procedura. Korzystając ze specjalnych zasobów, możesz zminimalizować lub całkowicie zapobiec ryzyku włamania się do witryny i chronić ją przed szkodliwymi botami.

Pospiesz się, aby chronić swoją witrynę!

Tutaj możesz zapoznać się z produktem.